「AIが言ったから」では人は納得できない

AIが別に差別意識があるとか、そういう人間的な意味であるわけではないですね。だから、統計的差別って言っているわけですけど。一度AIが「こういう傾向がいいよね」って学習してしまうと、その後自己成就、もう1回再生産されていってしまうっていうことです。

例えば、さっきの1型・2型・3型・4型っていうタイプがあった時に、「3型の人が良いんだよ」っていうのがもし学習されたとしますよね。「なら3型の良い人に良い仕事を与えましょう」ってなるじゃないですか。良い仕事を与えたら、成果が、良い成果が出ますよね。「ほら、やはり3型良かったじゃん!」。これが自己成就です。

もしかしたら、1型・2型とかもいろんな諸条件によっては良くなったりするかもしれないわけですね。あるいは極端な話、1型と2型とかは採るんじゃなくて、3型ばっかり採ろうって言ったら3型しかいなくなるんで、もう3型以外の1~2とか4~5の型の人たちっていうのは、良かったのか悪かったのか、もうわかんなくなってしまうわけです。

まさにこれ、サンプルセレクションの問題も発生してしまうわけです。これが、統計的差別の自己成就というものです。

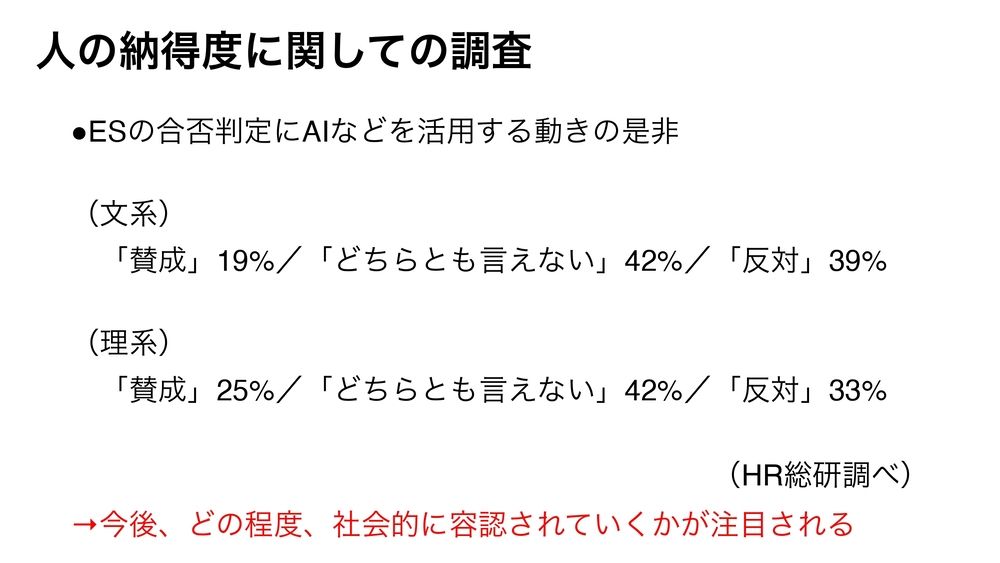

もう1つが、先ほどあった、(スライドを示して)人の納得度に関しての調査です。ESの合否判定にAIなどを活用する動きの是非ということで、これHR総研さんが調べたやつで、見ていただくと、ちょうど拮抗していますよね。文系はやはり反対が若干多いですかね。理系でも、若干賛成が多いと。

徐々にこういうAIの利用っていうのは、人よりも正確にやってくれるんじゃないかとか偏見がないんじゃないかとか、プレッシャーを感じないからいいとかですね。徐々に社会的に容認されている動きはありますけど。

これを完璧に、今AIで全部決まって受容できますかと。これは採用の例ですけど、「あなたは明日から東京から大阪に転勤していただきます」と。「なんでですか」「AIが言ったから」あるいは「統計的データ処理から大阪に合っていると思ったから」みたいな。これで納得いくのかどうかっていうお話です。

「人生を変えるような決定」をAIに任せていいのか

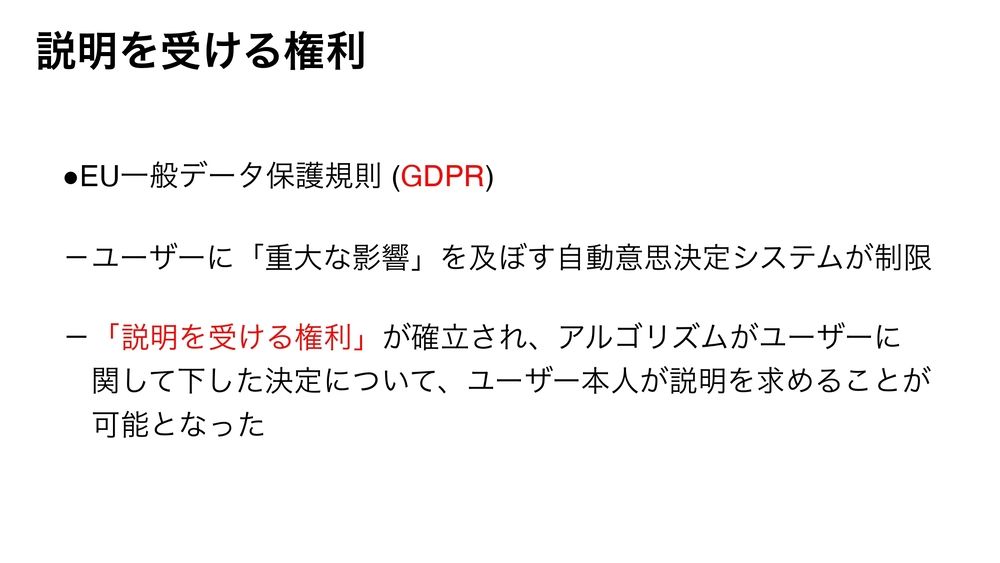

(スライドを示して)我々が今後気にしていかなきゃいけないものの1つに、EUの一般データ保護規則、通称GDPRと呼ばれているものがあります。EUがやっているってことは、基本的にEUと関係していない会社なんてほとんどないわけですから、基本的には全世界のルールが、ここらへんは横目で見ながらちゃんとやっていかなきゃいけないわけなんです。

要はユーザーに重大な影響を及ぼす自動意思決定システムが制限されると。例えば医療であったり法律であったりですね。これを自動意思決定システムで決めちゃダメよみたいなことです。だから人事だってまさにこれに当てはまってくるわけです。

ユーザーっていうのは要は評価される側ですね。一般の社員が重大な影響を及ぼす。例えば異動とか昇進、昇格、評価でボーナスが決まるとかですね。あるいは採用で自分の合否が決まると。めちゃくちゃ人生に重大な影響を与えるんですね。これを自動意思決定システムに委ねてはならないと。

プラスで、この説明を受ける権利ということが、言われています。いろんな権利、新しい技術に伴って、そういう権利的なものっていうのはどんどん出てくるわけなんですけど。

説明を受ける権利が確立されて、アルゴリズムがユーザーに関して下した決定についてユーザー本人が説明を求めることが可能だと。「なぜそうなんですか」と。だからさっき言ったように「AIが」とか、「なんかデータでやると相関が高かったから」とかっていうものだけでは足りない可能性があるということです。

ただ、ここらへん難しくて、最近だと生成AIが出てきて、その理由も「後付けでもいいから作ってくれ」ってやって作れちゃうような気もするんですね。だからこのあたりは極めてまだ微妙な話です。でも、一応こういう流れがあると。

重大な影響を及ぼすものを、自動意思決定システムに委ねてはいけない

もう一度言いますけど、重大な影響を及ぼすものを、自動意思決定システムに完全に委ねるのはダメだと。そういう説明を受ける権利っていうのがあるので、それに対する対策っていうのを取っておかないと今後問題が起こってくる可能性がありますよっていうのも、越えていかなきゃいけない壁じゃないかなと思います。

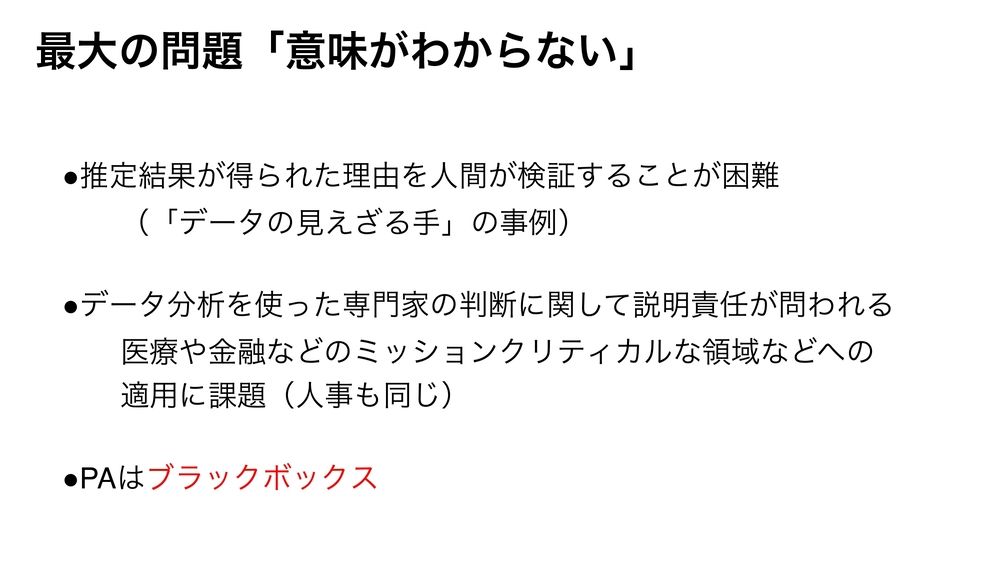

ただここらへん、「じゃあ説明しろ」って言われても難しいのが、やっぱり人間ではわからない真実の発見っていうのを最初のほうに聞きましたよね。それがある意味メリットでもあるわけですよ。データドリブンの人事分析、あるいは判断っていうのは、人間の勘とか経験ではわからなかった事実・真実みたいなものっていうのがわかると。

ところが、意味がわかんないっていうのはどういうことかっていうと、確かにこういう人は活躍するけど、理屈としてなぜこの3型の人が活躍するのかがわからないみたいなことですね。

これ、(スライドを示して)『データの見えざる手』っていう、ちょっと昔の本ですけど、ありまして。おもしろいなと思ったのが、ある小売りの店舗のところで、いろんなセンサーをつけて店員さんがいろいろ動きとかを見ていたわけですね。

どんな話だったかというと、ある場所に店員さんが立っているとなぜか売上が上がると。それが何回やっても真実なわけです。なぜかわかんないけど、たぶん人の流れとか、いろいろあるんだと思うんですけど。

そのある人が、この店員さんがこのポジションに立っていると、売上が上がる点っていうのがあると。人事とかじゃなければ、「よくわからんけども、ここに立っていれば売上が上がるんだったら立っとこうよ」で済むかもしれないんですけど、人事でそれが成り立つかどうかっていうことですね。

下手をするとブラックボックスになる「データドリブン」な人事

あと、データ分析を使った専門家の判断に関して説明責任を問われる。先ほど言ったやつですね。医療とか金融、ミッションクリティカルな領域などで適用に課題。人事も同じだと。つまり、ピープルアナリティクス、データドリブンの人事っていうのは、下手をするとブラックボックスになってしまう。

結局先ほどの、この説明を受ける権利って言われても、統計的な方程式をお話したら、それは説明になっているのかっていうと、たぶん受けるほうとしたら、「計算の仕方はわかったんだけど、でもなんで」ってたぶん言うと思うんですよね。

その人間が納得のいくような意味のある理屈っていうものを、紡ぎ出せるかどうかっていうことも、特に人事という領域におけるデータドリブンな判断においては重要になってくるということでした。

こういう中で説明可能なピープルアナリティクスがあり得るかってことなんですけど、じゃあ今までの人間の説明っていうのは正しかったの? という問題も実はあるわけですね。

Googleのリサーチ責任者はこんなことを言っています。「認知心理学者が見出したのは、人間に尋ねても実は意思決定のプロセスにはたどり着けない」と。「自由意思を持っていない」みたいな感じですね。「人はまず意思決定を行い、その後で尋ねられたら、その時に説明を生み出す。ただ、その説明は本当の説明ではないかもしれない」。

ちょっと難しいんですけど、どういうことかって言うと。人間は自分で自由意思を持って、ある理屈に基づいて自分は正しい行動をしていると思っているだけであって、実は別の理由でその行動をやっているんじゃないかみたいなこともいっぱいあるわけですね。

人は「自分の意思」で行動していると思っているが……

心理学の世界では、後催眠健忘暗示って、これもちょっと難しいんですけど。催眠をかけて、暗示としてパンと手を打ったら靴を脱いで、自分の靴の中を見てくださいみたいな暗示をかけておくわけですね。ただしその後催眠健忘って「忘れろ」っていうことなんで、「この暗示は忘れてください」と。

つまり、まずそういう靴を見ろっていう暗示をかけた上で、いっぺんそういう暗示状態を解きますよね。パーンと叩くと。そうするとその人は靴をおもむろにこう見たりするわけです。

その時に、「なぜあなたは今、靴の裏を見たんですか」っていう。本当の理由は「暗示を受けたから」じゃないですか。「そういう指示を受けたから」ですよね。ところが不思議なことに、その時はなんらかの自分に正当性があるような、作り話をするわけです。

「なんか最近靴を買おうと思っていたんだけど、今履いている靴のブランドってそういえばなんだったかなぁ」っていうのを、「足の大きさがどのくらいだったか忘れたので、もう1回見ました」とか、言ったら「間違った偽の理由」なんですけど、そういうことを言っている可能性もあると。

……ってことを考えると、「どっちやねん!」みたいな話ばっかりしてて申し訳ないんですけど。人間だって説明可能ではない判断をしているとも言えるわけですね。ですからそれを考えると、先ほど見ていただいた、この意味がわからないで説明を受ける権利を満たすことがどこまで可能なのかっていうところは、難しい問題になってきます。

データドリブンは仮説検証を永遠に続けていく作業

ただ、難しいからと言って、これは諦めてはダメと言いますか。おそらくこのデータドリブンな人事をやる担当者として、我々担当者は、関わる人たちっていうのは常に今申し上げたようなさまざまな問題点を、最後まで完璧には到達しないかもしれないですけど、考えながらやっていかないといけない。

なんとなく「使いやすいから」と言って、バンバン何も考えずにやってしまってはいけなくて、いろいろ落とし穴があるっていうことを、しっかりと肝に銘じながら使わないとものすごい大怪我をする、鋭い切れ味のある武器(データドリブンな人事)ですからね。そういったこともあり得るというお話でした。

ですからピープルアナリティクスっていうのは、もう絶対的な答えががんがん出てくるわけじゃなくて、仮説検証の習慣だと考えたほうがいいかなと思います。常に出てきたケースっていうのは絶対的な答えというよりは後で覆されるかもしれない仮説であると。

だからまた次に検証してデータがそのとおり、結果どおりにならなかったら仮説を変えていくとか、みたいなものをどんどんやっていく、これに尽きるかなと思います。

こういう姿勢でやらないと、あまりにもピープルアナリティクスは数字で出るんで、「神が与えてくれた白か黒かはっきりしてわかりやすい」みたいな感じで思うかもしれませんけど。それでやってはダメだということですね。

例えば「採用ミスマッチが多いのは学生の質のせいだ」と言っても、特定の面接官とか特定のポジションに偏っているみたいなこともわかってきて。データで示されていることっていうのが覆されることだってあるわけですね。ですから、データドリブンは仮説検証を永遠に続けていくような作業だと思ったほうがいいかもしれません。

というわけで私の話は以上でおしまいです。長い時間ご視聴いただきましてありがとうございます。

PR

PR